TL;DR: Rust + Async = Coda di Lavoro Potenziata

Il runtime asincrono di Rust è come dare alla tua coda di lavoro un'iniezione di espresso mescolato con carburante per razzi. Permette l'esecuzione concorrente dei compiti senza il sovraccarico dei thread a livello di sistema operativo, rendendolo perfetto per operazioni legate all'I/O come la gestione di una coda di lavoro. Scopriamo come possiamo sfruttare questo per creare un backend che farà volare i tuoi compiti più velocemente di un ghepardo caffeinato.

I Mattoni: Tokio, Futures e Canali

Prima di iniziare a costruire la nostra coda di lavoro ad alte prestazioni, familiarizziamo con i protagonisti principali:

- Tokio: Il coltellino svizzero... ehm, voglio dire, il versatile runtime asincrono per Rust

- Futures: Rappresentazioni di calcoli asincroni

- Canali: Tubature di comunicazione tra le diverse parti del tuo sistema asincrono

Questi componenti lavorano insieme come una macchina ben oliata, permettendoci di costruire una coda di lavoro che può gestire un throughput impressionante senza sudare.

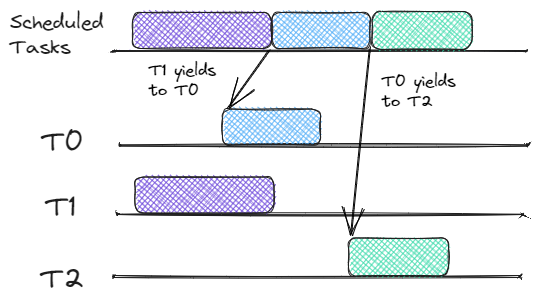

Progettare la Coda di Lavoro: Una Vista dall'Alto

La nostra coda di lavoro sarà composta da tre componenti principali:

- Ricevitore di Lavoro: Accetta i lavori in arrivo e li spinge nella coda

- Coda di Lavoro: Memorizza i lavori in attesa di essere elaborati

- Processore di Lavoro: Estrae i lavori dalla coda e li esegue

Vediamo come possiamo implementare questo usando le funzionalità asincrone di Rust.

Il Ricevitore di Lavoro: Il Buttafuori della Tua Coda

Per prima cosa, creiamo una struttura per rappresentare i nostri lavori:

struct Job {

id: u64,

payload: String,

}

Ora, implementiamo il ricevitore di lavoro:

use tokio::sync::mpsc;

async fn job_receiver(mut rx: mpsc::Receiver, queue: Arc>>) {

while let Some(job) = rx.recv().await {

let mut queue = queue.lock().await;

queue.push_back(job);

println!("Ricevuto lavoro: {}", job.id);

}

}

Questa funzione utilizza il canale MPSC (Multi-Producer, Single-Consumer) di Tokio per ricevere lavori e spingerli in una coda condivisa.

La Coda di Lavoro: Dove i Compiti Aspettano

La nostra coda di lavoro è un semplice VecDeque avvolto in un Arc> per un accesso concorrente sicuro:

use std::collections::VecDeque;

use std::sync::Arc;

use tokio::sync::Mutex;

let queue: Arc>> = Arc::new(Mutex::new(VecDeque::new()));

Il Processore di Lavoro: Dove Avviene la Magia

Ora per il pezzo forte, il nostro processore di lavoro:

async fn job_processor(queue: Arc>>) {

loop {

let job = {

let mut queue = queue.lock().await;

queue.pop_front()

};

if let Some(job) = job {

println!("Elaborazione lavoro: {}", job.id);

// Simula un po' di lavoro asincrono

tokio::time::sleep(Duration::from_millis(100)).await;

println!("Lavoro completato: {}", job.id);

} else {

// Nessun lavoro, facciamo un breve riposo

tokio::time::sleep(Duration::from_millis(10)).await;

}

}

}

Questo processore funziona in un ciclo infinito, controllando i lavori e processandoli in modo asincrono. Se non ci sono lavori, fa una breve pausa per evitare di girare a vuoto.

Mettere Tutto Insieme: L'Evento Principale

Ora, colleghiamo tutto nella nostra funzione principale:

#[tokio::main]

async fn main() {

let (tx, rx) = mpsc::channel(100);

let queue = Arc::new(Mutex::new(VecDeque::new()));

// Avvia il ricevitore di lavoro

let queue_clone = Arc::clone(&queue);

tokio::spawn(async move {

job_receiver(rx, queue_clone).await;

});

// Avvia più processori di lavoro

for _ in 0..4 {

let queue_clone = Arc::clone(&queue);

tokio::spawn(async move {

job_processor(queue_clone).await;

});

}

// Genera alcuni lavori

for i in 0..1000 {

let job = Job {

id: i,

payload: format!("Lavoro {}", i),

};

tx.send(job).await.unwrap();

}

// Attendi che tutti i lavori siano processati

tokio::time::sleep(Duration::from_secs(10)).await;

}

Potenziare le Prestazioni: Consigli e Trucchi

Ora che abbiamo la nostra struttura di base, vediamo alcuni modi per spremere ancora più prestazioni dalla nostra coda di lavoro:

- Batching: Elabora più lavori in un singolo compito asincrono per ridurre il sovraccarico.

- Prioritizzazione: Implementa una coda di priorità invece di un semplice FIFO.

- Back-pressure: Usa canali limitati per evitare di sovraccaricare il sistema.

- Metriche: Implementa il monitoraggio per controllare la dimensione della coda, il tempo di elaborazione e il throughput.

Possibili Trappole: Attenzione!

Come con qualsiasi sistema ad alte prestazioni, ci sono alcune cose a cui prestare attenzione:

- Deadlock: Fai attenzione all'ordine dei lock quando usi più mutex.

- Esaustione delle Risorse: Assicurati che il tuo sistema possa gestire il numero massimo di compiti concorrenti.

- Gestione degli Errori: Implementa una gestione degli errori robusta per evitare che i fallimenti dei compiti facciano crollare l'intero sistema.

Conclusione: La Tua Coda, Potenziata

Sfruttando il runtime asincrono di Rust, abbiamo creato un backend per la coda di lavoro che può gestire un throughput massiccio con un sovraccarico minimo. La combinazione di Tokio, futures e canali ci permette di processare i compiti in modo concorrente ed efficiente, sfruttando al massimo le risorse del sistema.

Ricorda, questo è solo un punto di partenza. Puoi ulteriormente ottimizzare e personalizzare questo sistema per adattarlo alle tue esigenze specifiche. Magari aggiungi un po' di persistenza, implementa i tentativi per i lavori falliti o distribuisci la coda su più nodi. Le possibilità sono infinite!

"Con grande potere viene grande responsabilità" - Zio Ben (e ogni programmatore Rust di sempre)

Quindi vai avanti, sfrutta il potere del runtime asincrono di Rust e costruisci code di lavoro che faranno ronfare di soddisfazione anche i sistemi più esigenti. Il tuo futuro te stesso (e i tuoi utenti) ti ringrazieranno!

Spunti di Riflessione

Prima di correre a riscrivere tutto il tuo backend in Rust, prenditi un momento per considerare:

- Come si confronterebbe questo con l'implementazione di un sistema simile in Go o Node.js?

- Che tipo di carichi di lavoro trarrebbero maggior beneficio da questa architettura?

- Come gestiresti la persistenza e la tolleranza ai guasti in un ambiente di produzione?

Buona programmazione, e che le tue code siano sempre veloci e i tuoi compiti sempre completati!